人工知能 〜 機械学習は、どこまで信用できるか

提供: 有限会社 工房 知の匠

文責: 技術顧問 大場 充

公開: 2026年3月22日

パーセプトロンが提案されて以来、コンピュータ科学の専門家達、すなわちチューリング機械を使った機械の計算に関する数学的な理論を研究していた人々は、パーセプトロンの機械としての計算能力の限界について、研究をつづけました。当初、パーセプトロンは、チューリング機械と同等の計算能力があると考えられていました。しかし、研究が進むと、パーセプトロンで計算できることは、チューリング機械の能力よりも、低いことが分かってきました。

図14.パーセプトロンの進化

パーセプトロンが提案されて以来、コンピュータ科学の専門家達、すなわちチューリング機械を使った機械の計算能力に関する数学的な理論を研究していた人々は、パーセプトロンの機械としての計算能力の限界について、研究をつづけました。当初、パーセプトロンは、チューリング機械と同等の計算能力があると考えられていました。しかし、研究が進むと、パーセプトロンで計算できることは、チューリング機械の計算能力よりも、低いことが分かってきました。それは、簡単な論理回路の機能である、排他的論理和を簡単なパーセプトロンで実現しようとしていも、実現するのが簡単なことではないことから分かります。

排他的論理和とは、論理和が2つの入力の片方、または両方が「真」であるとき、出力が「真」になる論理演算のことですが、2つの入力のどちらか一方だけが{真」の時、「真」を出力して、2つの入力の両方ともが「真」である場合には、「偽」を出力する論理演算です。この排他的論理和は、コンピュータを実現しようとするとき、加算などの計算にも使われます。この排他的論理和の計算を、パーセプトロンでし実現しようとすると、ほとんどの場合には、正しく動作する計算を、学習によって実現できますが、それを完全に、100パーセント正しく動作するようにしようとすると、学習した例の範囲では可能でも、それ以外の例で、正しく動作するかどうか保証できるまでには、なりません。これは、学校の試験で、教室で学んだ例に対しては、正しい答えを答えられても、習っていない例が出題されると、正しく答えられない場合が出ることを意味しています。

パーセプトロンの計算モデルは、数学的に考えれば、直前の状態(事前状態)が決まると、その後に何が起こる可能性があるかの事後状態が起こる確率を示す、マルコフ連鎖で表現できる計算と同じであることが分かりました。それは、理論的に言えば、系がある状態(事前状態)にある時、どのような入力があると、どのような出力を出して、その後、どのような事後状態に遷移するのかを指定できる、有限状態機械で計算可能な問題は、パーセプトロンでも、計算できると言う結論になります。マルコフ連鎖は、人間が使っている自然言語をモデル化するための道具としても利用されていました。それは、文字と文字との関連、単語と単語の関連、文章と文章との関係などの解析に向いたモデルであったことからも理解できます。また、簡単な機構をもった自動機械などの動きを示す場合にも、有限状態機械を使うことができます。

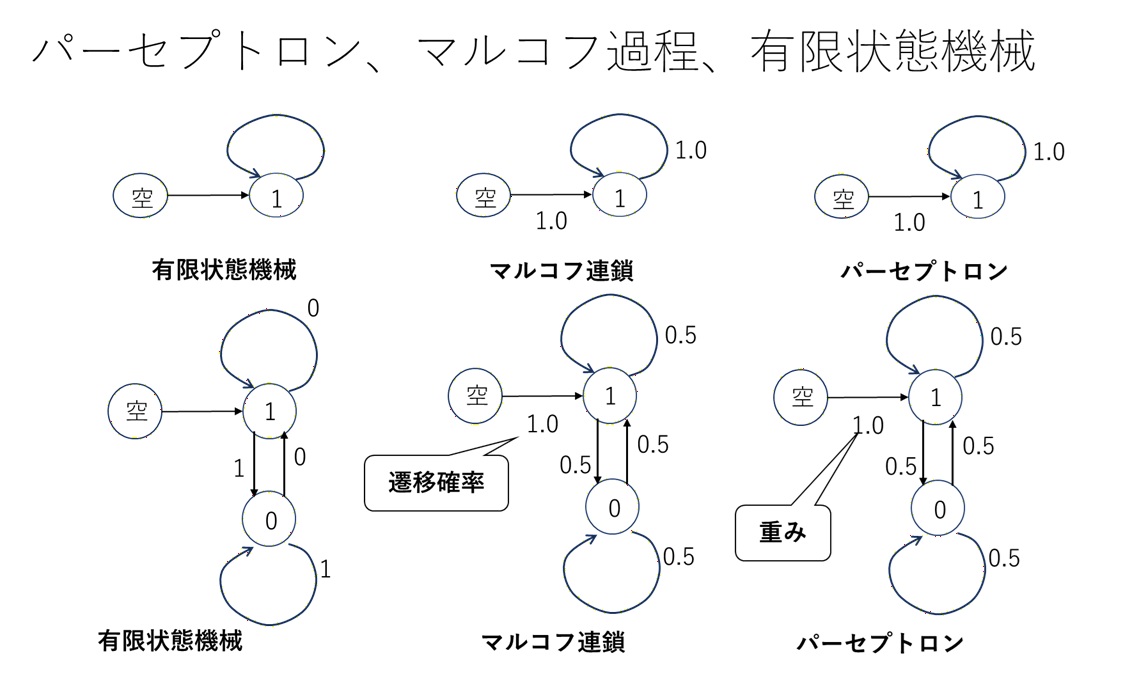

図14-1. パーセプトロンと有限状態機械

例えば、文字に注目すれば、英語の場合、文字eの出現頻度が高いことが知られています。さらに、マルコフ過程を応用することで、定冠詞のtheやthisのように、文字tの直後に、文字hが続く可能性が高いことも分かっています。それは、文の中にtheやthat、そしてthisやthere、thenなどの語が多数出現するからです。最近では、googleの自動翻訳で利用されている方法では、以前の文法解析を優先する方法ではなく、語の関連性を優先したマルコフ過程に基づく方法(大規模言語モデルと呼ばれています)が利用されて、自動翻訳の質が向上したと、言われています。

ただ、マルコフ過程に基づく計算は、有限状態機械の計算を真似ることはできますが、多大な記憶域を持ち、自由に指定できる記憶への書き込みや読み出しができる、記憶の利用に関する自由度が高く、アルゴリズムの表現がし易いチューリング機械の計算を、完全に真似ることはできないことも分かっています。これは、最近のAIツールとして代表的な、ChatGPTによる処理では、the sum of one and ten is…のような表現の処理では、正しい答えが、elevenであることが分からないと言う問題で知られています。これは、複数の語の間の関係だけに注目しているため、文の意味を分析していなかったからです。

簡単な状態遷移を実行するモデルの例を考えてみましょう。この計算モデルでは、最初の状態(処理の始まり)からは、何の入力がなくても、「1」の状態に遷移して、「1」を出力し、次の「1」の状態に遷移して、「1」を出力します。この状態遷移図に示された機械の動きを、マルコフ連鎖で表現すると、真ん中の図のようになります。ここでは、最初の「空」の状態から、「1」の状態への遷移は、確率1.0で起こります。さらに、次の遷移も、確率1.0で、「1」の状態へ遷移します。このマルコフ連鎖の動きは、右側に示されるパーセプトロンの図で示されます。パーセプトロンの図は、マルコフ連鎖の図と同じです。

次に、この状態遷移を少し変えた動きを実行するモデルの例を考えてみましょう。この計算モデルでは、最初の状態からは、何の入力がなくても、「1」の状態に遷移して、「1」を出力し、次に、「0」が入力されれば、「1」の状態に遷移して、「1」を出力します。しかし、「1」が入力された場合には、「0」の状態に遷移して、「0」を出力します。「0」の状態で、「1」が入力されれば、「0」の状態に遷移して、「0」を出力します。しかし、「0」が入力された場合は、「1」の状態に遷移して、「1」を出力します。この状態遷移図に示された機械の動きを、マルコフ連鎖で表現すると、真ん中の図のようになります。ここでは、最初の「空」の状態から、「1」の状態への遷移は、確率1.0で起こります。次の遷移は、確率0.5で、「1」の状態へ遷移する場合と、確率0.5で、「0」へ遷移して、「0」を出力します。「0」に遷移した場合、0.5の遷移確率で、状態「0」を繰り替えし、0.5の遷移確率で、「1」の状態に戻ります。このマルコフ連鎖の動きは、右側に示されるパーセプトロンの図で示されます。パーセプトロンでは、マルコフ連鎖では、状態遷移の確率として示されていた数値が、重みとして、表現されています。このパーセプトロンの図は、マルコフ連鎖の図と同じです。

現在のAIの原理の一つである、「機械学習」、すなわち機械による学習で得た知識を活用して、人間が考えているかのような動作を実行する機械を作ろうとする考えでは、このパーセプトロンと、それを大規模にして、能力を改善したニューロ・コンピュータや、それをさらに拡張した「深化学習」の理論や、大規模言語モデルの応用も、基本的には、マルコフ連鎖モデルの理論的な枠組みの制限を超えることはできません。ただ、それは、『人間の思考に似た「思考」は、機械で実行できない』と言う、結論を意味するものではありません。多分、あたかも『人間が考えたような、考えを述べる機械』は、作れるでしょう。

しかし、アラン・チューリングが提案した、機械が人間のように考えているかどうかを試験する、「チューリング・テスト」と呼ばれる、機械による人間のような思考を、人間が判定する審査を、通過する計算機の処理結果を出力できる機械を、近い将来に作り出すことは、可能なような気がします。