人工知能 〜 機械学習は、どこまで信用できるか

提供: 有限会社 工房 知の匠

文責: 技術顧問 大場 充

公開: 2026年3月23日

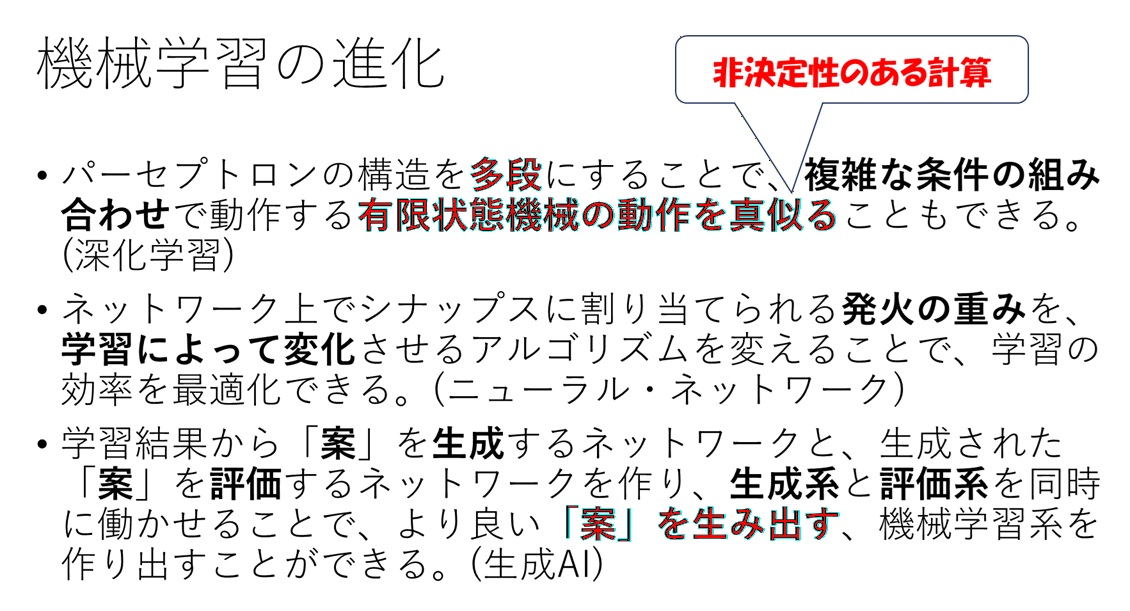

パーセプトロンが提案されて以来、コンピュータ科学の専門家達、すなわちチューリング機械を使った計算の限界に関する数学的な理論を研究していた人々は、パーセプトロンの機械としての計算能力の限界について、当初、パーセプトロンは、チューリング機械と同等の計算能力があると考えていました。しかし、研究が進むと、パーセプトロンで計算できることは、チューリング機械の能力よりも、低いことが分かってきました。その簡単な例が、排他的論理和の計算でした。その後、研究者たちは、このパーセプトロンの限界を打ち破ろうと、その改良に努力しました。

図15. 人工知能技術の進化

パーセプトロンは、ニューロンの数を増やし、ネットワークを多段化して、多段のネットワークを作れば、複雑な動きをする有限状態機械と同等な計算を真似ることができることが、分かってきました。巨大で複雑なネットワークを作れば、囲碁や将棋で、理論的には、人間と対等に勝負ができる能力を持った機械を作れることも分かりました。

大規模なニューロン・シナップスのネットワークを効率よく使うためには、シナップスとニューロンを接続する部分で参照する発火の重みを、どのように決めるかのアルゴリズムが重要になります。重みの決め方は、学習の効率に、大きく影響を与えるからです。さらに、それは、与えられた「学習に利用する」例題の集合に対して、ある範囲で、一定の(ほぼ同じと言える)学習成果を期待できるようにするため、学習の収束性を保証することが、重要になります。与えられた学習材料に対して、望まれる出力を完全に満足する結果に、最終的に同じ学習結果に到達できなければならないからです。ニューロ・コンピュータの理論で提案されたバックワード・プロバゲーション法は、そのような収束性が保証されている方法の一つです。

それは、ネットワークの出力が、人間が期待した出力と異なるとき、大規模なネットワークの最も最終出力の生成に近い最終層の各ニューロンに接続する、全てのシナップスに割り振られている「重み」を、期待する答えに合わせて増減させて微調整をすることで、期待する最終結果に近づけるようにします。この操作を最終層の各ニューロンから始めて、1段ずつ遡(さかのぼ)り、最も入力に近い第1段目の層に至るまで、繰り返します。このような「重み」の更新を行うことで、同じ例題を同じ順序で与えれば、同じ学習結果が得られるようになります。「重み」の更新を繰り返すことは、副作用を利用することであり、チューリング機械の場合と同じく、非決定性をもつ計算になります。

また、最近では、生成AIの分野で、人間に対して、案の評価だけでなく、案の作成ができる機械の開発に適した、機械学習の方法が研究され、提案を作成する機械学習と、提案を評価する機械学習を同時に動作させて、より良い提案を作り出す方法も提案されています。従来のAIでは、案を分析して、案を評価する処理(計算)は、AIの適合する分野とされていましたが、人間に対して、案を提示する処理は、「適合しない」とされていました。この問題を克服しようとする研究が行われています。

openAI社が開発した、chatGPTは、そのような新しい機械学習の技術を取り入れ、人間から出される質問に対して、インターネット上に公開されている情報を検索して、人間に分かり易い表現で、回答を提示する人工知能ツールの代表例です。chatGPT以外にも、様々な企業が、似たような人工知能ツールを開発し、提供を始めています。重要なことは、これらのツールが参照している情報は、インターネット上に公開された情報で、その真偽が検証されている情報ではなく、それぞれの情報の提供者が、提供したいと意図している情報の内容なので、ツールが提示する表現そのものは、分かり易いのですが、その内容について、真偽の保証はありません。

現時点の技術水準では、ある情報の内容の真偽を判定できるまでのアルゴリズムや方法は、分かっていません。

図15-1. 機械学習の問題

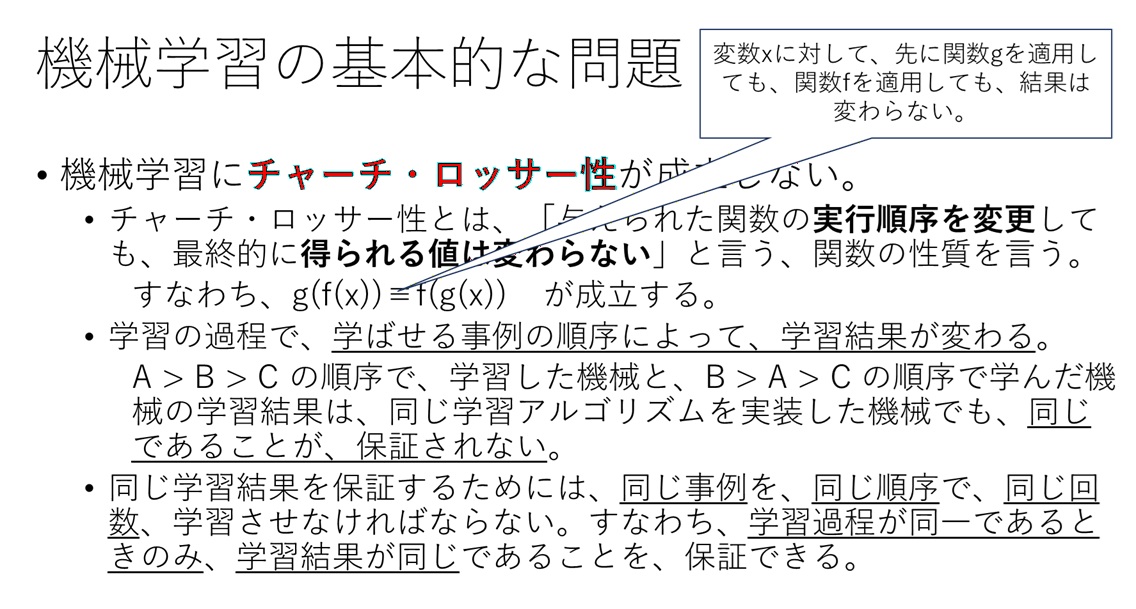

ここで、人工知能技術の中核である、機械学習に関する基本的な問題について、議論します。そのもっとも重要な問題は、機械学習が、人間が機械に与える「学習で学ぶべき例」の問題と、人間が正しいと考える答えが、機械学習の結果に与える「思考の偏り」です。

ここでは、特に、ラムダ計算で問題にされる、「チャーチ・ロッサー性」に注目します。チャーチ・ロッサー性とは、計算理論の研究で用いられている関数型言語のラムダ計算で、特に関数型計算で重要な「副作用のない」計算を保証する性質で、関数の適用順序を変化させても、計算結果に違いがないことを言い、「合流性」とも言われます。例えば、変数xに対して、関数fを先に適用してから、その結果に関数gを適用した結果と、先に関数gを適用した後に、関数fを適用した場合の計算結果が違わないことを言います。当初、チューリング機械の研究者達は、チャーチ・ロッサー性は、チューリング機械で言う「決定性がある」ことと同じであると予想していました。しかし、研究が進むと、この2つの概念が、理論的には異なっていることが分かりました。そのチャーチ・ロッサー性に似た性質は、「機械学習」においても成り立ちません。機械学習では、学習の非チャーチ・ロッサー性が成り立つと言えます。これは、機械が同じ学習材料の集合で学習を行っても、学習させる教材の学習順序が違う場合、学習の結果として獲得された知識が、同じでないことがあることを意味しています。もちろん、学習教材の全ての例について、2つの機械学習で動作する系の出力(答え)は、基本的に同じです。しかし、学習教材になかった事例が入力になった時、この2つの系の出力が同じではないことがありえます。これは、学習の結果として獲得された、全てのシナップスの「重み」の集合が、完全には同じではないことを意味しています。

2つの系が、基本的に同じ学習結果を獲得するためには、学習によってシナップスに割り振られた重みを変化させるアルゴリズムが同一であっても、「同じ学習教材を、全て同じ順序で、同じ回数、学んだとき」のみ、同じ結果になると言えます。つまり、たとえ同じ教材の集合でも、その学習教材の要素の並びが異なっていれば、同じ学習結果にはなりません。例えば、学習教材の実行順序が、完全に逆順に並んでいるとすれば、同じ教材集合であるにもかかわらず、学習結果として得られる「重み」集合の値は、同じではありません。

これは、現在の機械学習が、「重み」を更新して進める、副作用を応用した計算であり、上述したように、非決定性をもった計算だからです。その結果、機械学習を利用した系の計算結果は、確率論的に「正しい結果を出力する」としか、言えないのです。これまでのアルゴリズムに従った計算結果が、同じ条件では、同じ計算結果を出力する、プラトン的な思想に従っていたのとは、基本的に異なるのです。

図15-2. 機械学習とアルゴリズム

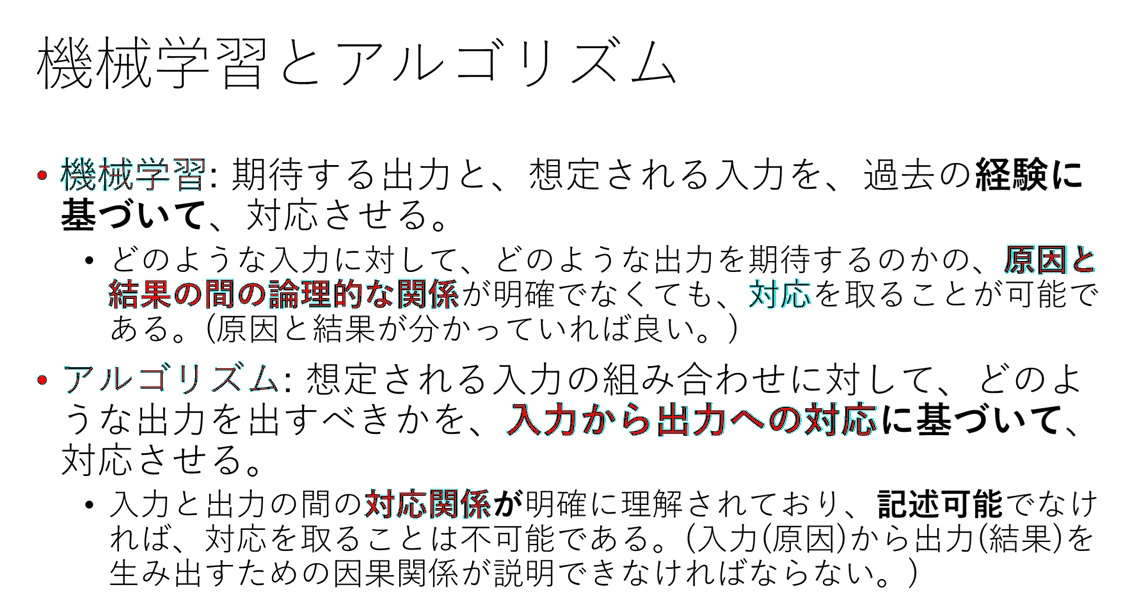

チューリング機械の計算と、機械学習を応用した機械の計算の違いについて、まとめます。

チューリング機械の場合、ある入力に対する出力の対応は、仕様によって、明確に記述され、その記述に沿った計算が実行されることが、プログラムの実現後に、テストによって、確認されます。チューリング機械の場合、非決定性があるため、この入力から出力への対応は、それ以前の計算の途中結果の影響を受ける可能性があります。テストでは、そのような副作用が意図しない悪影響を生じさせていないことを、慎重に確認しなければなりません。

これに対して、機械学習を応用した系の場合は、学習過程で与えられた教材による学習の結果に基づいて、原因である入力と、期待される出力である結果の対応をとります。このとき、入力と出力の間の論理的な関係は問題にしません。もちろん、原因と結果との間に、明確に論理的な関係が見出される場合には、学習した内容から、自然にその因果関係を学びます。逆に、原因と結果との間に、明確に論理的な関係が見出せなくても、経験的に関係が推定できれば、原因と結果は、自動的に結び付けられます。

これまでのコンピュータによる計算は、チューリング機械に代表されるアルゴリズムに基づいた処理で、予めプログラムに指定されている計算手順に従って、記憶域に蓄積されている変数の値を参照しながら、計算を進めてゆきます。これに対して、機械学習の原理に基づいた計算を応用した人工知能の処理では、過去の入力と出力との経験的な関係から導きだされる、統計的な因果関係によって、出力を定めます。それは、プラトンが主張した、現実から得られた経験を抽象化して、論理的な説明付けができる因果関係に基づいた思考を行う方法と、アリストテレスが主張した、現実に経験されていることから、それらを総合して言うことができる結論を得る方法との、選択の問題となります。